Dos sonhadores que tentavam imaginar um futuro ainda longínquo à cultura popular, da ficção científica dos anos 70 e 80 aos dias de hoje, a relação entre humanos e robôs passou de pura imaginação à realidade, mesmo que em proporções menores até ao momento.

Nos dias de hoje, o termo “Inteligência Artificial” já faz parte do léxico comum de várias áreas de trabalho, onde “robôs” já desempenham algumas tarefas que facilitam o dia-a-dia e o trabalho de humanos – desde o hotel japonês gerido quase na totalidade por robôs, aos algoritmos, como o do Spotify ou Netflix, que preveem o tipo de conteúdos que nos poderão interessar com base na nossa utilização.

A Inteligência Artificial

Importa primeiro perceber o que é inteligência artificial. O conceito é algo difuso, mas relaciona-se com a ideia de máquinas conseguirem realizar tarefas que tipicamente consideraríamos que apenas humanos as poderiam fazer. De acordo com esta definição, o que pode ser considerado inteligência artificial muda com o tempo e evolui de acordo com a perceção por parte da sociedade do que máquinas conseguem ou não fazer. Em 1950 foram escritos aqueles que são considerados os primeiros exemplos de inteligência artificial: um jogo de xadrez e um de damas. Hoje, dados os avanços na tecnologia, nos algoritmos e naquilo que conseguem hoje fazer, dificilmente alguém pensaria num jogo de xadrez ou damas como exemplo de inteligência artificial.

Neste sentido, a inteligência artificial já influencia a forma de trabalhar de humanos. Os softwares de produtividade, por exemplo, já têm em si um conjunto de capacidades que no passado seriam consideradas exclusivamente humanas – programas de correio eletrónico que analisam automaticamente o conteúdo das mensagens e o relembram que fez uma pergunta a alguém há uns dias e lhe lembra que ainda não foi respondida, ou uma mensagem em que lhe é solicitada uma reunião e o programa sugere-lhe automaticamente a marcação da mesma na sua agenda eletrónica são apenas dois exemplos entre muitos outros.

Desta forma, e voltando à definição de inteligência artificial, torna-se difícil perceber até que nível chegará a colaboração dos robôs com humanos ou se alguma vez os substituirão, porque implica isso um limite àquilo que a inteligência artificial pode ou não atingir – limite esse que está constantemente a ser ultrapassado.

A Inteligência Artificial e o Trabalho

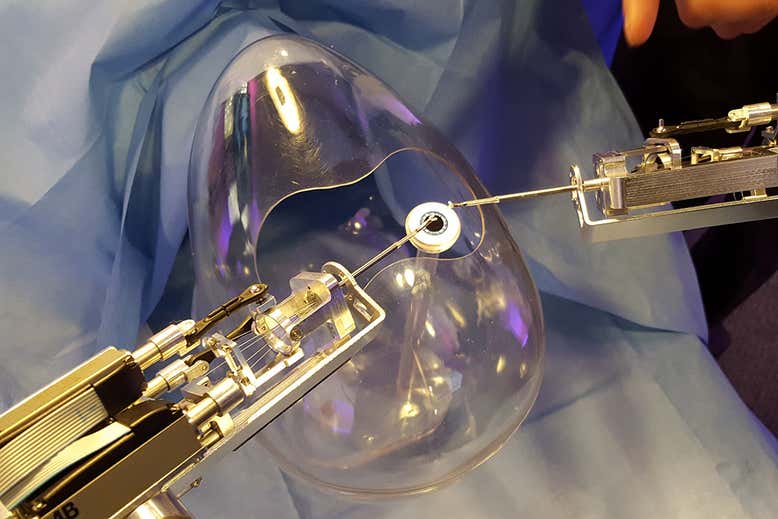

A capacidade de máquinas realizarem determinadas tarefas está apenas indiretamente ligada à complexidade. Hoje temos robôs a fazerem cirurgias aos olhos – técnicas de elevada complexidade – mas não temos robôs que sejam capazes de providenciar cuidados geriátricos – de complexidade bem mais reduzida. A capacidade ou não de máquinas realizarem determinadas tarefas tem a ver com o facto de estas poderem ser classificadas de rotineiras – existe uma rotina específica para as realizar – ou de envolverem características que hoje ainda consideramos exclusivamente humanas e que estão ligadas a fatores como a criatividade ou emoção. É muito mais fácil fazer um robô que consegue construir um computador, do que um que consiga fazer companhia a um idoso por exemplo.

Já no que diz respeito às organizações, as mesmas estão sempre interessadas em colaborados que possam criar valor. As vantagens que surgem com os avanços tecnológicos, no domínio da inteligência artificial, podem ser usadas, por exemplo, pelos gestores de Recursos Humanos. Hoje são usados, de forma relativamente frequente, algoritmos “inteligentes” para ajudar no recrutamento de colaboradores, ajudando a que o retorno por euro gasto em anúncios seja maior. Basta imaginar algoritmos que, com base no padrão de trocas de emails, na análise de palavras-chave, nas horas a que são enviados emails e outros dados, e nas interações digitais que as empresas hoje geram, consigam sinalizar trabalhadores com maior risco de burn-out, que estejam insatisfeitos, as possíveis razões dessa insatisfação, entre outros fatores. Isto levanta, de forma clara, questões de privacidade – dimensão importante nesta dinâmica que assenta na utilização de cada vez mais dados e algoritmos mais avançados de forma a obter ganho económico.

O Machine Learning – algoritmos computacionais que permitem a programas de computador o seu melhoramento através da experiência de utilização – leva a que as organizações, com o seu auxílio, desenvolvam os seus processos e técnicas de trabalho, tornando-se mais eficientes. Com base na experiência de utilização, conseguem detetar determinados padrões e elaborar regras heurísticas de comportamento que constituem, em si mesmo, novos conhecimentos e técnicas. Um programa de streaming de música consegue, através da identificação de padrões nas suas músicas favoritas, sugerir-lhe músicas que têm uma maior probabilidade de ser do seu agrado e que, depois, de acordo com o seu comportamento de resposta – se ouviu muitas vezes a música sugerida ou não – levam a que o algoritmo vá aperfeiçoando as regras de sugestão, de forma a aumentar cada vez mais a sua eficácia nas sugestões. Estas regras não existiam e foram criadas pelos algoritmos, constituindo em si novo conhecimento.

A Inteligência Artificial, a Sociedade e o Futuro

A inteligência artificial traz possibilidades, e será a maneira como for empregue e usada que determinará as consequências para a sociedade. As máquinas passam a ter maior capacidade de desempenhar tarefas que são repetitivas e até perigosas, trazendo uma maior capacidade de criar riqueza e bem-estar, mas ao mesmo tempo levantando questões éticas, que merecem reflexão profunda. Atualmente, parecem ser esses problemas éticos a representar um dos maiores obstáculos à generalização de veículos e condução autónoma. Imagine-se um carro de condução autónoma que, por fatores externos, tem de decidir entre duas opções de condução: A primeira implica um risco de vida para o condutor, mas evita quaisquer danos a um peão; na segunda invertem-se os papéis. Como deve ser feito o algoritmo? O que deve decidir se posto nesta hipotética situação?

Ao mesmo tempo, existe o risco de que a Inteligência Artificial coloque em causa postos de trabalho que hoje damos por garantidos. Isso já está a acontecer. Repare-se que com a queda do preço das tecnologias de automação e computação, e com a evolução tecnológica das mesmas, torna-se cada vez mais acessível a substituição de determinados postos de trabalho por máquinas.

Num estudo recente que desenvolvido com colegas da Nova SBE, chegámos à conclusão de que 50% do tempo despendido em tarefas laborais no presente é suscetível de ser automatizado recorrendo à tecnologia já disponível e que, face aos avanços previstos até 2030, esta percentagem atinja os 67%. Isto implica que cerca de 700 mil trabalhadores em Portugal – cerca de 15% da força de trabalho – terão de alterar as tarefas que realizam e adquirir novas capacidades até 2030.

Este processo, em si, não é nada de novo. No final do século XVIII, quando foi inventado o tear mecânico, também houve um impacto social e económico grande e o seu inventor, de acordo com relatos, foi perseguido e teve de fugir da cidade por ameaças de trabalhadores que viram os seus empregos postos em causa. A grande diferença para o cenário atual tem a ver com a velocidade a que esta transição está a decorrer.

No entanto, o impacto da automação de processos também cria emprego. Estimamos que nos próximos 10 anos, num cenário otimista, poderão ser criados aproximadamente o mesmo número de postos de trabalho que aqueles perdidos com a automação. A questão é que os novos empregos – as novas ocupações – não irão ser ocupadas pelas mesmas pessoas cujos postos de trabalhos foram postos em causa pela automação. Isto faz com que seja imperativa uma política forte de requalificação profissional que permita à sociedade o aproveitamento máximo dos impactos na capacidade produtiva destas novas tecnologias, mas de forma socialmente sustentável.

É preciso também que se refira que uma máquina não tem sentimentos nem personalidade jurídica. Não é um ser autoconsciente. Naturalmente não pode nem sequer faz sentido, no cenário atual, que beneficie da mesma proteção jurídica que um humano. Não chocará ninguém que eu deixe o meu computador ligado 24 horas por dia, mas ninguém aceitaria que se exigisse o mesmo de um colaborador. No sentido das obrigações e no domínio da ética, pode-se perguntar se uma máquina tem o dever de, havendo a possibilidade para tal e ainda que não seja para isso que tenha sido programada, ajudar uma pessoa em perigo de vida, por exemplo. É uma discussão que já existe nos moldes que referi anteriormente. Não são perguntas de fácil resposta.

Uma das fontes de direito é precisamente a jurisprudência. Uma máquina, com recurso a Machine Learning por exemplo, consegue analisar um número imenso de decisões anteriores no mesmo contexto, muito mais do que qualquer ser humano algum dia poderia, e com base nisso emitir uma decisão, mas a ética e o direito estão alicerçados em princípios morais que vão sempre condicionar a sua aplicação. Estes princípios morais, as noções de bem e mal, de certo e errado, de justo e injusto, estão alicerçados em perceções humanas, princípios gerais partilhados pelas pessoas que constituem uma comunidade ou sociedade. Não é certamente uma tarefa fácil, mas se a história nos mostra alguma coisa, é que “impossível” é apenas uma palavra para descrever algo que ainda não foi feito.

É de se esperar, no entanto, que este avanço tecnológico seja acompanhado por regulação que imponha limites e controlos à ação dos sistemas inteligentes, regulações estas que serão, como assim o são todas, baseadas em princípios éticos e de moralidade. Um bom exemplo são as três leis de Asimov.

Por fim, a pergunta mais relevante é se podemos confiar mais em sistemas automatizados do que na alternativa – sistemas dependentes de forma direta de ação humana. Em alguns casos a resposta é pouco controversa. Ninguém põe em causa que semáforos fazem o seu trabalho de forma segura, provavelmente mais segura até do que polícias sinaleiros, por exemplo. As máquinas de contar dinheiro seguramente cometem menos erros que as pessoas. À medida que pensamos em sistemas mais complexos, há mais “peças” do mecanismo (peças físicas ou partes funcionais de um algoritmo) que podem falhar, o que requer graus de validação dos procedimentos mais detalhados. Mas já fazemos isso no dia a dia. Qualquer automóvel hoje já tem um sem número de sistemas automatizados de apoio à condução, de proteção ativa e passiva e que dependem da análise continua do meio-ambiente e de uma resposta adequada. Resposta esta que em alguns casos seria impossível de fazer por humanos, dada a velocidade a que são feitas.